지금까지는 ChatGPT를 통해 답변을 알아보고 좋은 질문을 하는 방법, 실제 업무에 활용할 수 있는 방법 등을 알아봤습니다. 하지만 이런 ChatGPT에도 사용함에 있어서 여러 부작용들이 있을 수 있습니다. 오늘은 ChatGPT를 사용하며 미리 염두에 두어야 할 부작용을 몇 개 알아보려고 합니다.

1. 개인정보 유출

가장 대표적인 부작용이라 할 수 있는 개인정보 유출에 대한 내용입니다. 워낙 방대한 데이터를 가지고 있으며 이런 데이터는 기업의 기밀 정보나 개인에 대한 정보 등이 포함될 수 있습니다. 질문을 하면서도 ChatGPT에게 기업의 데이터를 전달하거나 개인의 정보를 전달할 수도 있으며 우리는 최대한 경계하며 질문을 해야 할 것입니다.

이러한 문제를 해결하기 위해서 ChatGPT의 개발진은 ChatGPT Enterprise를 제공하고 있습니다. 더 나은 보안과 개인 정보 보호, 데이터 보호 등 다양한 기능을 사용할 수 있는 ChatGPT 4버전 이상에서 사용할 수 있는 툴입니다. 이를 통해 우리는 개인 정보와 관련된 다양한 문제를 사전에 방지할 수도 있을 것입니다.

2. 허위 사실 유포

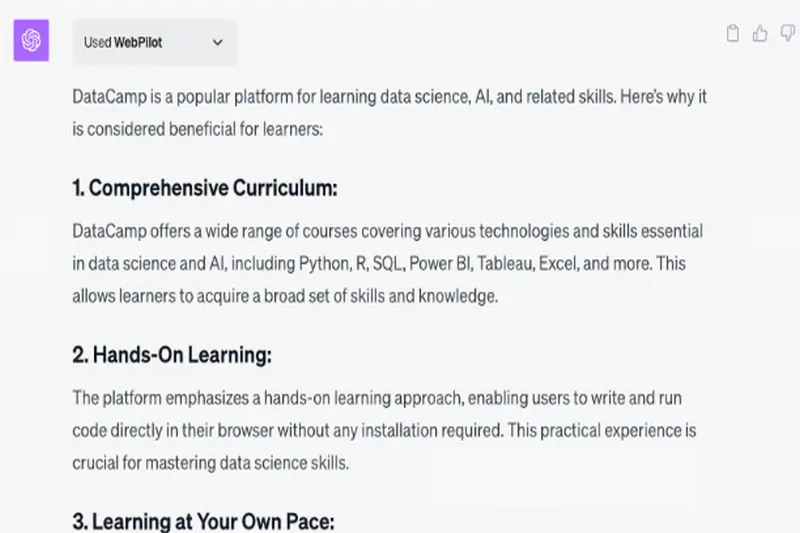

이전에도 알아봤듯이 ChatGPT라 해도 모든 것이 맞는 정보를 전달하지는 않습니다. 정해진 답이 있는 수학적인 문제라 해도 틀릴 수 있으며, 이는 항상 검토해보는 습관을 들여야 하는 이유가 됩니다.

또한 현실과 구분할 수 없는 가짜 콘텐츠에 대한 내용이 있을 수 있습니다. 가짜 뉴스, 가짜 정보에 대한 내용은 각종 악성 루머를 만들거나 잘못된 방향으로 인도할 수도 있다는 점을 간과하지 말아야 할 것입니다.

3. 사이버 범죄 주의

정해진 답이 있거나 심화적인 답이 존재하는 사이버 코드를 쉽게 생성할 수 있는 ChatGPT는 다양한 사이버 범죄에 악용될 수도 있습니다. 이전에는 전문적인 지식이 없으면 생성할 수 없는 악의적 코드를 쉽게 생성할 수 있으며, 사이버 범죄에 대한 진입 장벽이 낮아졌다는 우려의 시선도 있습니다.

또한 PC 시스템을 사용하는 사이버 범죄는 정교한 글쓰기를 통해 나올 수 있습니다. ChatGPT의 글쓰기 능력 및 메일 작성 능력은 일반 사용자가 작성하는 문장과 매우 흡사합니다. 이를 통해 언제든 스팸 메일이나 피싱 등의 사이버 범죄가 발생할 수 있다는 사실을 경계하며 AI를 사용하는 것이 좋겠습니다.

앞서 살펴본 3가지의 ChatGPT가 불러온 부작용을 제외하고도 우리가 경계해야할 AI의 부작용은 무궁무진합니다. 이는 우리가 AI를 현명하게 사용해야할 이유가 있으며 더욱 잘 사용하는 방법에 대해 탐구해야할 이유가 되기도 합니다.